AUTOR: Ing. CPC. Hernán Capcha Carbajal

Las siglas IA (Inteligencia Artificial) últimamente está siendo muy utilizada por los contadores incluso como sinónimo de ChatGPT, en eventos académicos donde se tratan otros temas al final las consultas se refieren a la IA(ChatGPT) y su impacto en la contabilidad.

Esto debido a la exageración y palabrería que en forma alarmista o exageradamente optimista vemos en redes sociales respecto al impacto de esta tecnología en contabilidad.

Por ejemplo, Elon Musk predijo en 2019 que habría un millón de robot-taxis para 2020 y en 2016 dijo de Marte: «Si las cosas van según lo planeado, deberíamos poder lanzar personas probablemente en 2024, llegando en 2025».

Pero, hasta ahora nada de ello, y ¡en contabilidad también sucede!

También contribuye con ello el FOMO, la epidemia del siglo XXI

FOMO son las siglas de «Fear Of Missing Out«, en español, «miedo a perderse algo» o quedar afuera de eventos interesantes especialmente causado por cosas vistas en las redes sociales».

En contabilidad surgen en masa por generación espontánea a raíz del éxito de chatGPT «expertos aplicando IA en contabilidad», los «visionarios de la muerte de la contabilidad por IA» y los «tecnofuturistas que solamente repiten lo que está en internet».

Aunque mejor es practicar EL ESCEPTICISMO CIENTIFICO, ejemplo Rodney Brooks es un científico que anualmente hace predicciones sobre tecnología utilizando el escepticismo científico.

https://rodneybrooks.com/predictions-scorecard-2024-january-01/

Dada la amplitud del tema en este artículo por cada aspecto mencionado compartiremos links de acceso a las publicaciones que sustentan nuestra perspectiva.

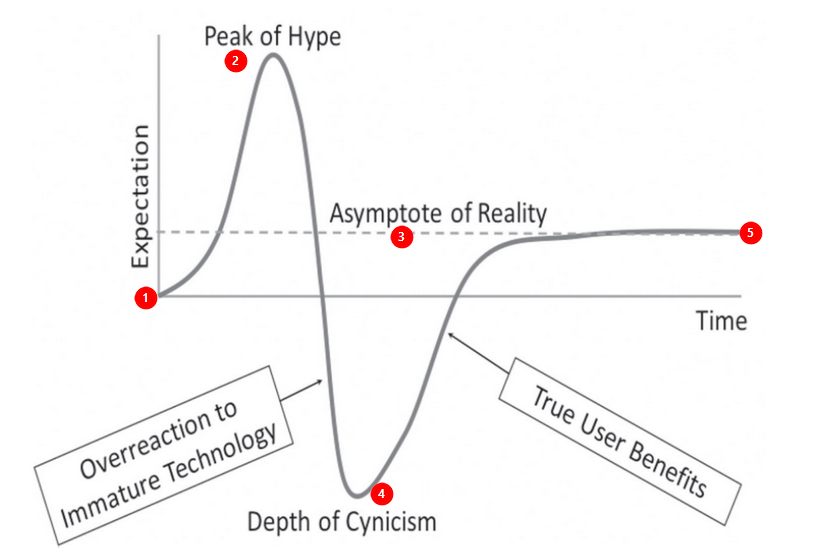

La palabrería y exageración sucede con toda tecnología y lo de IA en contabilidad lo podemos explicar en las curvas de exageración

La fase lanzamiento (1) de la nueva tecnología estimula la exageración y palabrería muy por encima de la realidad en forma positiva o negativa y se llega la fase de Pico de la exageración (2), a medida que se trata de aplicar o gozar de los exagerados beneficios, la realidad (3) muestra que ello no es posible, genera una sobrerreacción sin considerar que aún la tecnología es inmadura y surge una gran desilusión para caer en la profundidad del cinismo (4) o decepción, en cambio los usuarios más racionales que saben de la iniciales limitaciones, que son superadas por la maduración de la nueva tecnología van encontrando la forma de aplicar y gozar de los beneficios y las verdaderas potencialidades de la nueva tecnología (5) .

La aplicación de IA en contabilidad está en la fase 2 y nos falta mucho para llegar a la objetividad o fase 5, para ello debemos ser usuarios racionales.

https://mindmatters.ai/2024/02/ai-and-wall-streets-hype-curve/

Y como en toda herramienta también hay limitaciones y riesgos, por ejemplo, las ALUCINACIONES EN IA son un grave problema. Bill Gates ha indicado que ChatGPT o modelos similares de IA podrían algún día proporcionar consejo médico a las personas sin acceso a los médicos. Pero no se puede ni debe confiar en los consejos de una máquina propensa a alucinaciones. Aunque debemos precisar que no son errores, es característica inherente al modelo

https://spectrum.ieee.org/ai-hallucination

Aunque ya se trabaja para mitigar y disminuir las alucinaciones de ChatGPT

por lo pronto están clasificadas así:

1. Inexactitudes fácticas: produce una declaración que es objetivamente incorrecta.

2. Reclamaciones no soportadas: genera una respuesta que no tiene base en la entrada o el contexto.

3. Declaraciones sin sentido: produce una respuesta que no tiene sentido o no está relacionada con el contexto.

4. Escenarios improbables: genera una respuesta que describe un evento inverosímil o altamente improbable.

https://medium.com/@colin.fraser/hallucinations-errors-and-dreams-c281a66f3c35

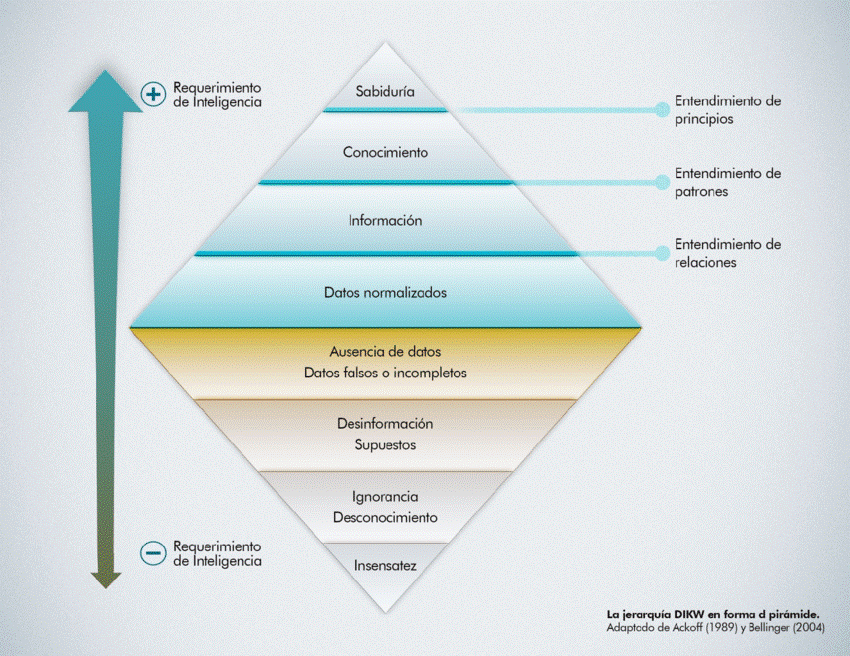

También contribuye a la exageración y palabrería la falta de información objetiva y realista (en internet hay poca) lo que incrementa el desconocimiento de lo que realmente es IA

La jerarquía de DATO, INFORMACIÓN y CONOCIMIENTO representada en la imagen nos ayuda a encontrar la explicación especialmente en la pirámide invertida que es lo que abunda mayormente.

https://articulospm.wordpress.com/wp-content/uploads/2013/08/gestic3b3n-de-conocimiento-dikw.pdf

Para acelerar la llegada a la objetividad debemos salir de la pirámide invertida mostrada anteriormente, para ello debemos conocer la IA por dentro…. ¡No es magia!

ChatGPT es un software basado en un modelo con una sólida base en matemáticas y estadística. IA es un programa informático como cualquier otro, funciona en una máquina, recibe datos de entrada, procesa y genera salidas.

Y, lo más importante, y debemos recordar siempre, que la IA no es inteligente en el sentido de “entender” lo que hace. El resultado de frases producidas, aunque bien construidas y que tienen sentido para nosotros, como las que vemos genera ChatGPT, son frutos de cálculos probabilísticos.

Un modelo de lenguaje es una distribución de probabilidad sobre tokens (fragmentos de palabras). El propósito de los LLM (ChatGPT) es encontrar el siguiente token más probable dados los tokens y datos de entrenamiento anteriores. ChatGPT no está tratando de ser útil o veraz.

Por cierto, un token no tiene ningún significado semántico. El LLM no «sabe» que está escribiendo un poema o haciendo un diagnóstico. Solo sabe que está buscando el siguiente token más probable, teniendo en cuenta los tokens anteriores y los datos de entrenamiento. Lo único que sustenta la calidad de la salida de un modelo de lenguaje a la verdad es la relación de la verdad con las frecuencias de token en los datos de entrenamiento, y no hay garantía de que esta relación sea sólida. No sabe si la fuente es verdadera o falsa, ya que ya está en la base de entrenamiento.

https://towardsdatascience.com/the-transformer-architecture-of-gpt-models-b8695b48728b

https://useo.es/ia/que-es-llm/

Lo cierto es que en Contabilidad la IA Generativa sigue siendo una gran solución en busca de un problema

Las herramientas de IA generativa son “equivalente a un practicante inexperto y a veces descuidado al que ocasionalmente podría delegar algunas tareas ….“.

https://www.axios.com/2024/04/24/generative-ai-why-future-uses

Respecto a la aplicación de IA en nuestras empresas

El entorno empresarial es muy diferente al entorno personal. Existen reglas de cumplimiento, estándares regulatorios, procesos de auditoría y, por supuesto, la expectativa de los gerentes de traducir las inversiones en tecnología en resultados positivos tangibles para el negocio.

En cuanto a las Universidades deberían priorizar aplicación del pensamiento crítico antes de las herramientas de Inteligencia Artificial generativa, específicamente CHATGTP

la dependencia excesiva de IA puede ser un escollo y aconseja a los estudiantes que exploren posibles soluciones a los problemas por sí mismos para que no pierdan ese pensamiento crítico. Deberíamos hacer de la IA un copiloto, no el piloto automático para aprender.

https://spectrum.ieee.org/ai-coding

CONCLUSIONES

- Los contadores deben ser conscientes de los contextos en los que la adopción de herramientas de IA será útil y ventajosa. Sin adoptar o rechazar ciegamente la tecnología.

- La adopción de IA en la función contable debe ser enfocada en tareas específicas considerando que forman parte de un proceso e impactará en otras áreas o procesos de la empresa.

- La IA no reemplazará a los contadores, pero los contadores que usen las herramientas de IA adecuadamente reemplazarán a los contadores que no lo hagan.

- Las universidades deben enfatizar la formación basada en el pensamiento crítico y conocimiento de los fundamentos de las tecnologías subyacentes de herramientas tecnológicas que van saliendo para que puedan evaluar e identificar objetivamente las que mejoren su desempeño profesional.